Manfaatkan kekuatan pengalihan 301 dalam skala besar LLM untuk meningkatkan pengalaman pengguna dan mengoptimalkan strategi SEO situs web Anda.

Pengalihan sangat penting untuk pemeliharaan setiap situs web, dan pengelolaan pengalihan menjadi sangat menantang saat profesional SEO berurusan dengan situs web yang berisi jutaan halaman.

Contoh situasi saat Anda mungkin perlu menerapkan pengalihan dalam skala besar:

- Situs e-dagang memiliki sejumlah besar produk yang tidak lagi dijual.

- Halaman berita terbitan yang sudah ketinggalan zaman tidak lagi relevan atau tidak lagi memiliki nilai historis.

- Mencantumkan direktori yang berisi daftar yang sudah ketinggalan zaman.

- Papan pekerjaan tempat postingannya kedaluwarsa.

Mengapa Pengalihan dalam Skala Besar Itu Penting?

Ini dapat membantu meningkatkan pengalaman pengguna, mengkonsolidasikan peringkat, dan menghemat anggaran perayapan.

Anda mungkin mempertimbangkan noindexing, tetapi ini tidak menghentikan Googlebot dari perayapan. Anggaran perayapan terbuang seiring bertambahnya jumlah halaman.

Dari sudut pandang pengalaman pengguna, membuka tautan yang sudah lama itu menyebalkan. Misalnya, jika pengguna membuka tautan lowongan kerja yang sudah lama, sebaiknya mereka diarahkan ke tautan yang paling cocok untuk lowongan kerja yang masih aktif.

Di Search Engine Journal, kami mendapatkan banyak tautan 404 dari chatbot AI karena halusinasi saat mereka menciptakan URL yang tidak pernah ada.

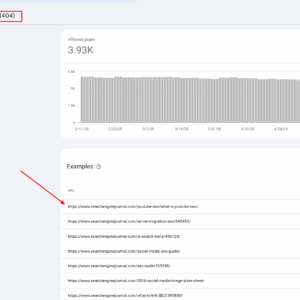

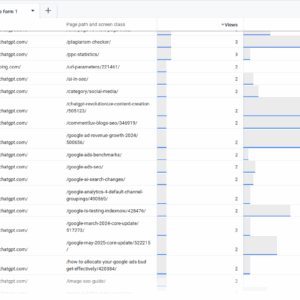

Kami menggunakan laporan Google Analytics 4 dan Google Search Console (dan terkadang log server) untuk mengekstrak 404 halaman tersebut dan mengarahkannya ke konten yang paling cocok berdasarkan slug artikel.

Ketika chatbot mengutip kita melalui halaman 404 , dan orang-orang terus datang melalui tautan rusak, itu bukanlah pengalaman pengguna yang baik.

Siapkan Kandidat Pengalihan

Pertama-tama, baca postingan ini untuk mempelajari cara membuat basis data vektor Pinecone. (Harap dicatat bahwa dalam kasus ini, kami menggunakan “primary_category” sebagai kunci metadata, bukan “category.”)

Agar ini berfungsi, kami berasumsi bahwa semua vektor artikel Anda sudah tersimpan dalam database “article-index-vertex”.

Siapkan URL pengalihan Anda dalam format CSV seperti dalam contoh file ini . Itu bisa berupa artikel yang sudah ada yang telah Anda putuskan untuk dipangkas atau 404 dari laporan konsol penelusuran atau GA4 Anda.

Informasi “primary_category” opsional adalah metadata yang ada dalam rekaman Pinecone artikel Anda saat Anda membuatnya dan dapat digunakan untuk memfilter artikel dari kategori yang sama, sehingga meningkatkan akurasi lebih jauh.

Jika judul hilang, misalnya, di URL 404, skrip akan mengekstrak kata-kata slug dari URL dan menggunakannya sebagai masukan.

Hasilkan Pengalihan Menggunakan Google Vertex AI

Unduh kredensial layanan Google API Anda dan ganti namanya menjadi “config.json,” unggah skrip di bawah ini dan file contoh ke direktori yang sama di Jupyter Lab, lalu jalankan.

Anda akan melihat uji coba dengan hanya lima rekaman, dan Anda akan melihat file baru bernama “redirect_map.csv,” yang berisi saran pengalihan.

Setelah Anda memastikan kode berjalan lancar, Anda dapat menetapkan TEST_MODE boolean ke true False dan menjalankan skrip untuk semua URL Anda.

Jika kode berhenti dan Anda melanjutkannya, kode akan melanjutkan dari tempat kode tersebut berhenti. Kode juga akan memeriksa setiap pengalihan yang ditemukannya terhadap berkas CSV.

Pemeriksaan ini mencegah pemilihan URL basis data pada daftar yang dipangkas. Pemilihan URL tersebut dapat menyebabkan pengulangan pengalihan tak terbatas.

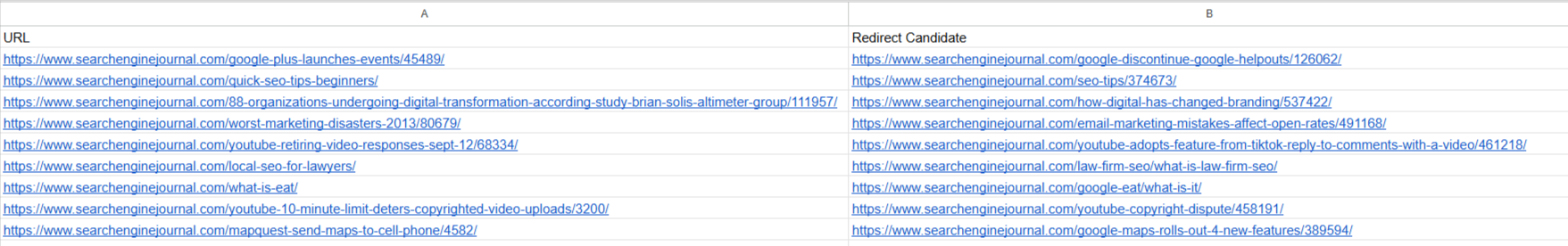

Untuk URL contoh kami, outputnya ditunjukkan di bawah ini.

Sekarang kita dapat mengambil peta pengalihan ini dan mengimpornya ke pengelola pengalihan di sistem manajemen konten (CMS), dan selesai!

Anda dapat melihat bagaimana ia berhasil menyamai artikel berita lama tahun 2013 “YouTube Menghentikan Respons Video pada 12 September” dengan artikel berita tahun 2022 yang lebih baru dan sangat relevan “YouTube Mengadopsi Fitur dari TikTok – Balas Komentar dengan Video.”

Juga untuk “/what-is-eat/,” ditemukan kecocokan dengan “/google-eat/what-is-it/,” yang merupakan kecocokan yang 100% sempurna.

Hal ini bukan hanya karena kekuatan kualitas Google Vertex LLM, tetapi juga hasil pemilihan parameter yang tepat.

Saat saya menggunakan “RETRIEVAL_DOCUMENT” sebagai jenis tugas saat membuat penyematan vektor kueri untuk artikel berita YouTube yang ditampilkan di atas, hasilnya cocok dengan “YouTube Memperluas Postingan Komunitas ke Lebih Banyak Kreator,” yang masih relevan tetapi tidak secocok yang lainnya.

Untuk “/what-is-eat/,” cocok dengan artikel “/reimagining-eeat-to-drive-higher-sales-and-search-visibility/545790/,” yang tidak sebagus “/google-eat/what-is-it/.”

Jika Anda ingin menemukan kecocokan pengalihan dari kumpulan artikel baru Anda, Anda dapat meminta Pinecone dengan satu filter metadata tambahan, “publish_year,” jika Anda memiliki bidang metadata tersebut dalam rekaman Pinecone Anda, yang sangat saya sarankan untuk dibuat.

Dalam kode, itu adalah PUBLISH_YEAR_FILTERvariabel.

Jika Anda memiliki publish_yearmetadata, Anda dapat menetapkan tahun sebagai nilai array, dan itu akan menarik artikel yang diterbitkan pada tahun yang ditentukan.

Hasilkan Pengalihan Menggunakan Penyematan Teks OpenAI

Mari kita lakukan tugas yang sama dengan model “text-embedding-ada-002” milik OpenAI. Tujuannya adalah untuk menunjukkan perbedaan output dari Google Vertex AI.

Cukup buat file buku catatan baru di direktori yang sama, salin dan tempel kode ini, lalu jalankan.

Dalam hal SEO, meskipun Google Vertex AI tiga kali lebih mahal daripada model OpenAI, saya lebih suka menggunakan Vertex.

Kualitas hasil jauh lebih tinggi. Meskipun Anda mungkin mengeluarkan biaya lebih besar per unit teks yang diproses, Anda mendapatkan keuntungan dari kualitas output yang lebih unggul, yang secara langsung menghemat waktu berharga dalam meninjau dan memvalidasi hasil.

Berdasarkan pengalaman saya, biayanya sekitar $0,04 untuk memproses 20.000 URL menggunakan Google Vertex AI.

Meski dikatakan lebih mahal, namun masih sangat murah, dan Anda tidak perlu khawatir jika Anda menangani tugas yang melibatkan beberapa ribu URL.

Dalam hal pemrosesan 1 juta URL, harga yang diproyeksikan akan menjadi sekitar $2.

Jika Anda masih menginginkan metode gratis, gunakan model BERT dan Llama dari Hugging Face untuk menghasilkan penyematan vektor tanpa membayar biaya per panggilan API.

Biaya sebenarnya berasal dari daya komputasi yang diperlukan untuk menjalankan model, dan Anda harus membuat penyematan vektor dari semua artikel Anda di Pinecone atau basis data vektor lainnya menggunakan model tersebut jika Anda akan membuat kueri menggunakan vektor yang dihasilkan dari BERT atau Llama.

Ringkasan: AI Adalah Sekutu Kuat Anda

AI memungkinkan Anda meningkatkan skala upaya SEO atau pemasaran Anda dan mengotomatiskan tugas-tugas yang paling membosankan.

Hal ini tidak menggantikan keahlian Anda. Hal ini dirancang untuk meningkatkan keterampilan Anda dan membekali Anda untuk menghadapi tantangan dengan kemampuan yang lebih besar, sehingga prosesnya menjadi lebih menarik dan menyenangkan.

Menguasai alat-alat ini sangat penting untuk meraih kesuksesan. Saya sangat ingin menulis tentang topik ini untuk membantu para pemula belajar dan merasa terinspirasi.

Saat kita melangkah maju dalam seri ini, kita akan menjelajahi cara menggunakan Google Vertex AI untuk membangun plugin tautan internal WordPress.